>> Unir les efforts pour repousser les escroqueries en ligne

>> Le PM promulgue un plan pour la mise en œuvre de la Loi sur la cybersécurité

>> Cybersécurité au Vietnam : vers une gouvernance axée sur les résultats

|

| Si l’intelligence artificielle ouvre des perspectives considérables, son développement doit s’inscrire dans un cadre responsable. |

| Photo : CTV/CVN |

Selon une enquête sur la cybersécurité menée en 2025 auprès des particuliers, le nombre de victimes d’arnaques en ligne a reculé par rapport à 2024 : environ une personne sur 555 (soit 0,18%) en a été victime, contre 0,45% l’année précédente. Cette baisse reflète les efforts conjoints des autorités, des entreprises technologiques et des médias en matière de sensibilisation.

Cependant, cette amélioration ne signifie pas la disparition des menaces. Au contraire, celles-ci gagnent en complexité. Le deepfake, en particulier, brouille les repères traditionnels d’authentification : images, voix et vidéos, longtemps considérées comme des preuves fiables, ne suffisent plus à garantir l’authenticité.

Comme le souligne Vu Duy Hiên, représentant de l’Association nationale de cybersécurité, ces escroqueries reposent souvent sur des scénarios d’urgence destinés à pousser les victimes à agir sans vérification. Dans ce contexte, la protection des données personnelles devient cruciale, ces technologies s’appuyant largement sur des informations réelles accessibles en ligne.

L’expert en intelligence artificielle Vu Duy Hung met en garde : "Ce que l’on voit ou entend n’est plus nécessairement vrai". Les outils actuels permettent en effet de produire des contenus falsifiés d’un réalisme tel qu’ils sont difficilement détectables à l’œil nu.

Réguler l’IA, renforcer la vigilance citoyenne

Au-delà des risques d’escroquerie, la diffusion de contenus générés par l’intelligence artificielle soulève des enjeux juridiques et éthiques majeurs. Certains deepfakes peuvent porter atteinte à la vie privée, à la dignité des personnes et aux droits fondamentaux.

|

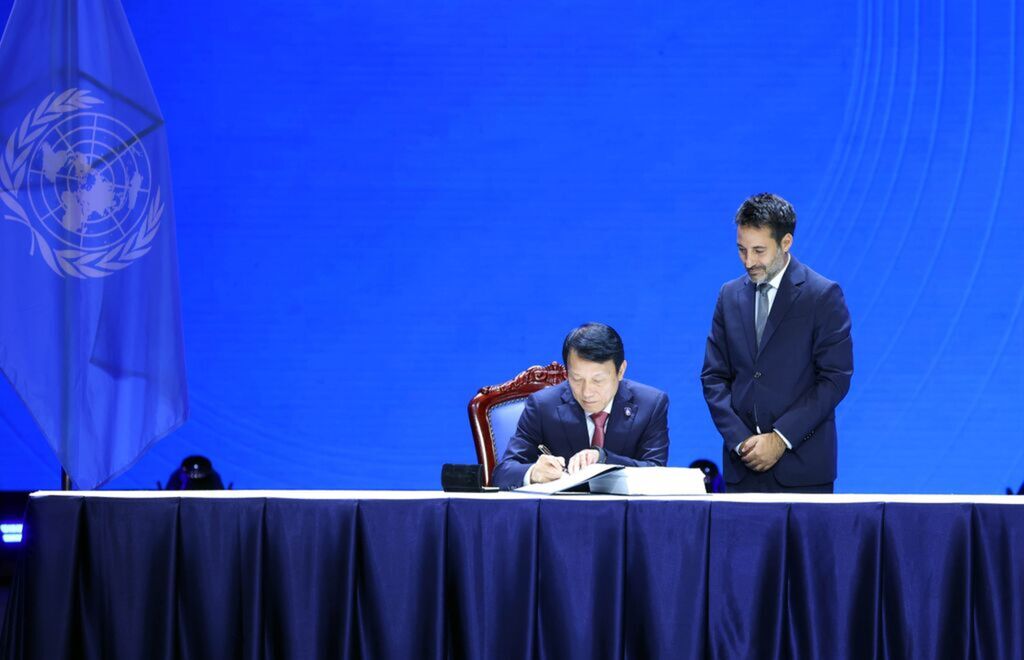

| Le ministre vietnamien de la Police, Luong Tam Quang, signe la Convention des Nations unies contre la cybercriminalité, le 25 octobre à Hanoï. |

| Photo : VNA/CVN |

Face à ces dérives, la mise en place d’un cadre juridique adapté s’impose. La loi sur l’intelligence artificielle, adoptée le 10 décembre 2025 et entrée en vigueur le 1er mars 2026, constitue à cet égard une avancée notable. Elle établit une classification des risques, précise les responsabilités des acteurs et renforce les pouvoirs de contrôle des autorités.

Le texte interdit notamment l’usage du deepfake à des fins frauduleuses et impose l’identification des contenus générés par l’IA. Il prévoit également des mécanismes de traçabilité ainsi que des mesures d’intervention en cas d’incident, pouvant aller jusqu’à la suspension ou au retrait des systèmes concernés.

Des publics vulnérables, une réponse éducative

Les jeunes apparaissent particulièrement vulnérables face à ces nouvelles formes de manipulation. Selon le professeur associé Trân Thanh Nam, la surcharge informationnelle, le phénomène de FOMO (peur de manquer une opportunité) et le manque d’esprit critique favorisent des décisions impulsives. À cela s’ajoutent une confiance excessive dans les contenus en ligne et une faible culture financière numérique.

Dans ce contexte, la sensibilisation et l’éducation au numérique deviennent essentielles. Les experts recommandent de faire preuve de prudence face à toute demande de transfert d’argent ou de communication d’informations personnelles, même lorsqu’elle semble provenir d’une source familière.

Vérifier les informations via des canaux officiels ou contacter directement les personnes concernées constitue désormais un réflexe indispensable pour limiter les risques. Parallèlement, les autorités renforcent les dispositifs de prévention et durcissent les sanctions à l’encontre des comportements frauduleux.

L’enjeu consiste désormais à concilier innovation et sécurité. Si l’intelligence artificielle ouvre des perspectives considérables, son développement doit s’inscrire dans un cadre responsable. Dans un monde où la frontière entre réel et virtuel s’estompe, garantir un usage sûr, éthique et durable des technologies s’impose comme une priorité collective.

Thao Nguyên / CVN