>> Résolution N°71 : Hanoï vise 50% des établissements scolaires appliquant l’IA d’ici 2030

>> L’Assemblée nationale accélère son virage numérique

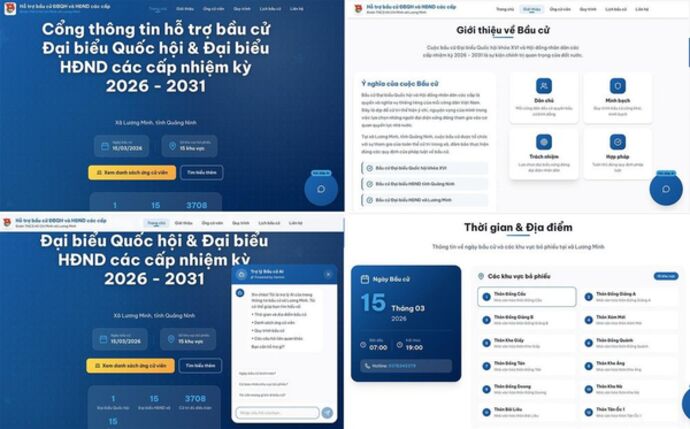

>> Appliquer l’intelligence artificielle dans le processus des élections législatives et locales

|

| L’IA est une technologie aux impacts profonds sur l’économie et la gouvernance nationale. |

| Photo : VNA/CVN |

Dans un contexte où de nombreux pays sont encore en phase d’élaboration de cadres politiques ou de publication de directives, l’adoption de la Loi sur l’IA par le Vietnam, avec une entrée en vigueur le 1er mars, fait de notre pays l’un des rares à avoir adopté une législation spécifique sur l'intelligence artificielle au niveau national.

Une gouvernance axée sur les risques et centrée sur l'humain

Selon le ministre des Sciences et des Technologies, Nguyên Manh Hùng, l’IA est une technologie qui a eu un impact considérable au cours des dernières décennies, modifiant les structures économiques et les modes de gouvernance des États. "La loi a été adoptée à la fois pour favoriser le développement et gérer proactivement les risques", a précisé le ministre Nguyên Manh Hùng.

Le ministre a également affirmé que l’IA est un outil d’assistance, mais que la décision finale sur les questions importantes de la société doit toujours revenir à l’humain. Ce principe a été fondamental lors de l’élaboration de la loi.

Les systèmes d’IA doivent être classés selon trois niveaux de risques : élevé, moyen et faible. Les fournisseurs sont responsables de cette classification avant de mettre les systèmes en service, sur la base des directives techniques qui seront publiées. En cas de doute sur le niveau de risque, les fournisseurs peuvent demander de l’aide au ministère des Sciences et des Technologies.

Pour les systèmes d’IA à haut risque, les fournisseurs doivent garantir la possibilité de surveillance et d’intervention humaines, ainsi que la mise à jour et la conservation des dossiers techniques et des journaux d’activités nécessaires pour l’évaluation de la conformité et le contrôle après la mise en service.

La loi précise également que la fourniture d’informations doit être "proportionnelle à l’objectif de vérification" et "ne pas divulguer de secrets commerciaux".

Les utilisateurs de systèmes d’IA à haut risque doivent respecter les procédures opérationnelles, les directives techniques et les mesures de sécurité, et ne pas intervenir illégalement pour modifier les fonctionnalités du système. Les mécanismes de contrôle et de surveillance sont conçus en fonction du niveau de risque.

Les systèmes à haut risque seront vérifiés périodiquement ou en cas de suspicion de violation ; ceux à risque moyen seront surveillés par des rapports, des contrôles aléatoires ou des évaluations d’organismes indépendants ; les systèmes à faible risque seront vérifiés en cas d’incident, de signalement ou si nécessaire pour garantir la sécurité.

Pour les systèmes d’IA déjà en service avant l’entrée en vigueur de la loi, les fournisseurs et les implémenteurs ont l’obligation de se conformer dans un délai de 18 mois pour les secteurs de la santé, de l’éducation et des finances, et de 12 mois pour les autres secteurs.

Afin de concrétiser ces dispositions, le ministère des Sciences et des Technologies prépare actuellement un projet de décision du Premier ministre concernant la liste des systèmes d’IA à haut risque. Ce projet établira cette liste en fonction de critères d’évaluation des risques, en veillant à ce qu’elle soit claire, transparente et réalisable.

Les systèmes d’IA à haut risque seront inclus dans la liste lorsque leurs résultats sont utilisés comme base ou facteur ayant une influence significative sur les décisions affectant les droits, obligations ou intérêts légitimes des organisations et des individus. Cela inclut les systèmes susceptibles de causer des conséquences graves en cas de défaillance ou ayant un impact difficile à contrôler par d’autres réglementations juridiques.

Les critères de classification des systèmes d’IA à haut risque incluent cinq groupes : l’impact sur les droits humains, la sécurité, le domaine et le contexte d’utilisation (comme la santé, l’éducation, l’emploi, la finance, le transport, l’énergie, etc.), le degré d’automatisation et le contrôle humain, ainsi que la portée des utilisateurs et l’ampleur de l’impact.

|

| La Loi sur l'IA, adoptée par l'Assemblée nationale en décembre 2025, est officiellement entrée en vigueur le 1er mars 2026. |

| Photo : VNA/CVN |

La liste prévue comprend quatre groupes de systèmes : ceux affectant les droits humains, ceux ayant un impact sur la sécurité, ceux dans des domaines essentiels liés aux intérêts publics, et ceux ayant une grande portée ou des impacts difficiles à corriger.

Exigence de transparence pour les contenus générés par IA

La loi impose également des exigences de transparence pour les contenus générés par l’IA. Les systèmes d’IA interagissant directement avec les humains doivent être conçus et opérés de manière à ce que les utilisateurs puissent les identifier, sauf disposition légale contraire.

Les fournisseurs doivent garantir que les contenus audio, visuels ou vidéo générés par l’IA sont étiquetés dans un format lisible par machine conformément aux règlements du gouvernement.

Les fournisseurs doivent informer clairement le public lorsque des documents, sons, images ou vidéos créés ou modifiés par l’IA sont diffusés, si ces contenus risquent de prêter à confusion quant à leur authenticité.

Pour les contenus destinés à simuler l’apparence ou la voix de personnes réelles ou à reproduire des événements réels, les fournisseurs doivent apposer une étiquette facilement identifiable pour les distinguer des contenus réels.

En ce qui concerne les œuvres cinématographiques, artistiques ou créatives, l’étiquetage doit être effectué de manière appropriée, sans entraver la présentation ou l’appréciation de l’œuvre.

La loi consacre également un chapitre sur le développement de l’infrastructure et la protection de la souveraineté nationale en matière d’IA. Ainsi, les organisations et les individus qui développent et maîtrisent les technologies d’IA de base bénéficieront de politiques de soutien et de privilèges spéciaux.

Les entreprises opérant dans le domaine de l’IA recevront le soutien le plus élevé possible, avec un accès facilité à l’infrastructure, aux données et aux environnements d’essai pour la recherche, la production et la commercialisation des produits et services d’IA.

Les PME bénéficieront de subventions pour les coûts, la formation et la connexion au marché. Les produits et services d’IA nationaux seront privilégiés par l’État dans le cadre des procédures d’appel d’offres.

La loi prévoit également le développement des ressources humaines en IA, en intégrant des contenus de base sur l’IA, la pensée computationnelle, les compétences numériques et l’éthique technologique dans les programmes d’enseignement obligatoires à tous les niveaux.

Les établissements d’enseignement supérieur et professionnel seront encouragés à développer des programmes de formation en IA, en sciences des données et dans des domaines connexes, tout en renforçant la coopération avec les entreprises, les instituts de recherche et les organisations internationales.

Pour assurer une mise en œuvre rapide de la Loi sur l’IA, le vice-Premier ministre Nguyên Chi Dung a signé, le 3 mars 2026, la décision N°367 sur le Plan de mise en œuvre de la loi. Ce plan vise à préciser les tâches, les délais et les responsabilités des agences et organisations concernées, en garantissant une mise en œuvre efficace et harmonieuse, tout en sensibilisant les ministères et les gouvernements locaux à la loi et à leur rôle dans sa mise en œuvre.

Thu Huong/CVN